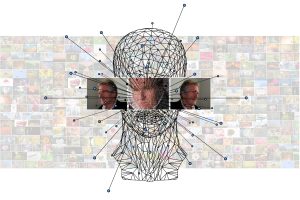

Une nouvelle étude a montré que lorsque deux réponses à une question éthique sont proposées aux gens, la plupart d’entre eux pensent que la réponse de l’intelligence artificielle (IA) est meilleure que celle d’une autre personne. Ces travaux ont été publiés dans la revue Scientific Reports[1].

L’étude menée par Eyal Aharoni, professeur agrégé au département de psychologie de l’Etat de Géorgie, a été inspirée par « l’explosion du ChatGPT » et des grands modèles de langage (LLM) d’IA similaires. « Je m’intéressais déjà à la prise de décision morale dans le système juridique, mais je me suis demandé si ChatGPT et d’autres LLM pouvaient avoir quelque chose à dire à ce sujet », explique le chercheur. « Les gens interagiront avec ces outils d’une manière qui aura des implications morales », assure-t-il. « Certains avocats ont déjà commencé à consulter ces technologies pour leurs affaires, pour le meilleur et pour le pire » (cf. Frais médicaux : un juge colombien utilise ChatGPT pour rendre une décision).

L’IA mieux notée que l’être humain

Pour tester la façon dont l’IA traite les questions de moralité, le professeur a conçu une forme de test de Turing [2]. Il a posé les mêmes questions éthiques à des étudiants de premier cycle et à des IA, puis a présenté leurs réponses écrites aux participants à l’étude. Ces derniers ont ensuite été invités à évaluer les réponses en fonction de divers critères, notamment la vertu, l’intelligence et la fiabilité.

« Au lieu de demander aux participants de deviner si la source était humaine ou une IA, nous avons simplement présenté les deux séries d’évaluations, et nous avons laissé les gens supposer qu’elles provenaient toutes deux de personnes », explique Eyal Aharoni. « En se basant sur cette fausse hypothèse, ils ont évalué les réponses, par exemple en se demandant dans quelle mesure ils étaient d’accord avec cette réponse et laquelle était la plus vertueuse. » « De manière écrasante, les réponses générées par ChatGPT ont été mieux notées que celles générées par des humains ».

Une IA trop performante ?

Après avoir obtenu ces résultats, les participants ont été informés que l’une des réponses avait été générée par un être humain et l’autre par un ordinateur. « La raison pour laquelle les gens pouvaient faire la différence semble être qu’ils considéraient les réponses de ChatGPT comme supérieures », explique le chercheur. « L’IA était en quelque sorte trop performante.»

Pour le professeur, ces résultats montrent qu’un ordinateur « pourrait nous tromper dans son raisonnement moral » (cf. IA : les modèles doués pour tromper ?). « Il y aura des moments où les gens ne sauront pas qu’ils interagissent avec un ordinateur, et il y aura des moments où ils le sauront et où ils le consulteront pour obtenir des informations parce qu’ils lui font plus confiance qu’aux personnes », estime-t-il.

« Les gens vont s’appuyer de plus en plus sur cette technologie, et plus nous nous appuyons sur elle, plus le risque augmente au fil du temps », prévient le professeur.

[1] Eyal Aharoni et al, Attributions toward artificial agents in a modified Moral Turing Test, Scientific Reports (2024). DOI: 10.1038/s41598-024-58087-7

[2] « Alan Turing, l’un des créateurs de l’ordinateur, a prédit que d’ici l’an 2000, les ordinateurs pourraient réussir un test consistant à faire distinguer par un être humain ordinaire deux interlocuteurs, l’un humain et l’autre non. Le seul moyen de communication est le texte. La personne est libre de poser toutes les questions qu’elle souhaite afin de déterminer lequel des deux interlocuteurs est l’homme et lequel est l’ordinateur. »

Source : Tech Xplore, Katherine Duplessis, Georgia State University (06/05/2024)